Ho paura. Molto spaventato.

La sorveglianza e la censura su Internet, rese possibili dall’inimmaginabilmente vasto potere computazionale dell’intelligenza artificiale (AI), sono qui.

Questa non è una distopia futuristica. Sta succedendo adesso.

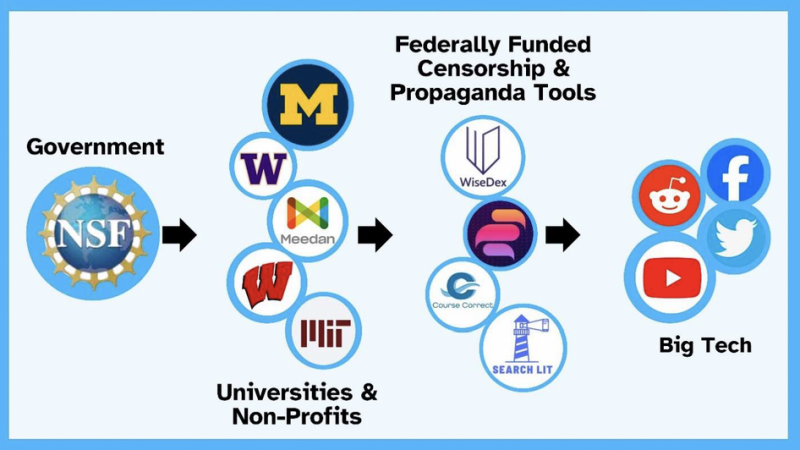

Le agenzie governative stanno collaborando con università e organizzazioni no-profit per utilizzare strumenti di intelligenza artificiale per sorvegliare e censurare i contenuti su Internet.

Questo non è politico o partigiano. Non si tratta di alcuna opinione o idea particolare.

Quello che sta succedendo è che uno strumento abbastanza potente da sorvegliare tutto ciò che viene detto e fatto su Internet (o gran parte di esso) sta diventando a disposizione del governo per monitorare tutti noi, in ogni momento. E, sulla base di tale monitoraggio, il governo – e qualsiasi organizzazione o azienda con cui collabora – può quindi utilizzare lo stesso strumento per sopprimere, mettere a tacere e chiudere qualunque discorso non gli piaccia.

Ma non è tutto. Utilizzando lo stesso strumento, il governo e i suoi partner pubblico-privati “non governativi” (si pensi, ad esempio, all’Organizzazione Mondiale della Sanità o alla Monsanto) possono anche chiudere qualsiasi attività collegata a Internet. Attività bancarie, acquisti, vendite, insegnamenti, apprendimento, intrattenimento, connessione tra loro: se all'intelligenza artificiale controllata dal governo non piace ciò che tu (o i tuoi figli!) dite in un tweet o in un'e-mail, può chiudere tutto per Voi.

Sì, lo abbiamo visto su scala molto locale e politicizzata, ad esempio, i camionisti canadesi.

Ma se pensassimo che questo tipo di attività non potesse, o non volesse, verificarsi su scala nazionale (o, cosa ancora più spaventosa, globale), dovremmo svegliarci adesso e renderci conto che sta accadendo e che potrebbe non essere fermabile.

Nuovi documenti mostrano che l’intelligenza artificiale finanziata dal governo è destinata alla censura online

La sottocommissione scelta della Camera degli Stati Uniti per l'armamento del governo federale è stata costituita nel gennaio 2023 "per indagare su questioni relative alla raccolta, analisi, diffusione e utilizzo di informazioni sui cittadini statunitensi da parte delle agenzie del ramo esecutivo, compreso se tali sforzi siano illegali, incostituzionali o altrimenti non etici".

Sfortunatamente, il lavoro del comitato è visto, anche dai suoi stessi membri, come in gran parte politico: i legislatori conservatori stanno indagando su quello che percepiscono come il silenzio delle voci conservatrici da parte delle agenzie governative di tendenza liberale.

Tuttavia, nelle sue indagini, questa commissione ha scoperto alcuni documenti sorprendenti relativi ai tentativi del governo di censurare il discorso dei cittadini americani.

Questi documenti hanno implicazioni cruciali e terrificanti per tutta la società.

Nella relazione provvisoria della sottocommissione, del 5 febbraio 2024, i documenti mostrano che gruppi accademici e no-profit stanno proponendo a un'agenzia governativa un piano per utilizzare i "servizi di disinformazione" dell'intelligenza artificiale per censurare i contenuti sulle piattaforme Internet.

Nello specifico, l'Università del Michigan sta spiegando alla National Science Foundation (NSF) che gli strumenti basati sull'intelligenza artificiale finanziati dalla NSF possono essere utilizzati per aiutare le piattaforme di social media a svolgere attività di censura senza dover effettivamente prendere decisioni su cosa dovrebbe essere censurato.

Ecco come viene visualizzata la relazione nella relazione della Sottocommissione:

Ecco una citazione specifica presentata nella relazione della sottocommissione. Proviene dalle "note del relatore della prima presentazione dell'Università del Michigan alla National Science Foundation (NSF) sul suo strumento WiseDex finanziato dalla NSF e basato sull'intelligenza artificiale". Le note sono in archivio presso la commissione.

Il nostro servizio di disinformazione aiuta i policy maker delle piattaforme che vogliono…attribuire la responsabilità di giudizi difficili a qualcuno esterno all’azienda…esternalizzando la difficile responsabilità della censura.

Questa è un’affermazione straordinaria su così tanti livelli:

- Equipara esplicitamente il “servizio di disinformazione” alla censura.

Questa è un’equazione cruciale, perché i governi di tutto il mondo fingono di combattere la disinformazione dannosa quando in realtà lo fanno approvando massicci progetti di legge sulla censura. Lo ha dichiarato il WEF “disinformazione e disinformazione” saranno i “rischi globali più gravi” nei prossimi due anni, il che presumibilmente significa che i loro maggiori sforzi andranno verso la censura.

Quando un appaltatore governativo dichiara esplicitamente che sta vendendo un “servizio di disinformazione” che aiuta le piattaforme online a “esternalizzare la censura”, i due termini sono riconosciuti come intercambiabili.

- Si riferisce alla censura come a una “responsabilità”.

In altre parole, si presuppone che parte di ciò che le piattaforme dovrebbero fare sia la censura. Non proteggere i bambini dai predatori sessuali o i cittadini innocenti dalla disinformazione: solo una censura pura e semplice, pura e semplice.

- Si afferma che il ruolo dell’intelligenza artificiale è quello di “esternalizzare” la responsabilità della censura.

Le piattaforme tecnologiche non vogliono prendere decisioni di censura. Il governo vuole prendere queste decisioni ma non vuole essere visto come un censore. Gli strumenti di intelligenza artificiale consentono alle piattaforme di “esternalizzare” le decisioni di censura e al governo di nascondere le proprie attività di censura.

Tutto ciò dovrebbe porre fine all’illusione che ciò che i governi di tutto il mondo chiamano “contrastare la disinformazione e l’incitamento all’odio” non sia una vera e propria censura.

Cosa succede quando la censura dell’IA sarà completamente implementata?

Sapendo che il governo sta già pagando per gli strumenti di censura dell’IA, dobbiamo capire cosa ciò comporta.

Nessun limite di manodopera: Come sottolinea il rapporto della sottocommissione, i limiti alla censura online del governo hanno coinvolto, fino ad ora, il gran numero di persone necessarie per esaminare infiniti file e prendere decisioni sulla censura. Con l’intelligenza artificiale, quasi nessun essere umano deve essere coinvolto e la quantità di dati che possono essere sorvegliati può essere vasta quanto tutto ciò che qualcuno dice su una particolare piattaforma. Quella quantità di dati è incomprensibile per un singolo cervello umano.

Nessuno è responsabile: Uno degli aspetti più spaventosi della censura dell’IA è che quando lo fa, non c’è nessun essere umano o organizzazione – che si tratti del governo, delle piattaforme o delle università/non-profit – che sia effettivamente responsabile della censura. Inizialmente, gli esseri umani forniscono allo strumento di intelligenza artificiale istruzioni su quali categorie o tipi di linguaggio censurare, ma poi la macchina va avanti e prende da sola le decisioni caso per caso.

Nessun ricorso per i reclami: Una volta che l’intelligenza artificiale sarà stata scatenata con una serie di istruzioni di censura, spazzerà via miliardi di punti dati online e applicherà azioni di censura. Se vuoi contestare un'azione di censura dell'IA, dovrai parlare con la macchina. Forse le piattaforme impiegheranno esseri umani per rispondere agli appelli. Ma perché dovrebbero farlo, quando dispongono di un’intelligenza artificiale in grado di automatizzare tali risposte?

Nessuna tutela per i giovani: Una delle affermazioni avanzate dalla censura governativa è che dobbiamo proteggere i nostri figli dalle informazioni online dannose, come i contenuti che li rendono anoressici, li incoraggiano al suicidio, li trasformano in terroristi dell’Isis e così via. Anche dallo sfruttamento sessuale. Sono tutte questioni serie che meritano attenzione. Ma per un gran numero di giovani non sono così pericolosi come lo è la censura dell’intelligenza artificiale.

Il pericolo rappresentato dalla censura dell’IA si applica a tutti i giovani che trascorrono molto tempo online, perché significa che le loro attività online e il loro linguaggio possono essere monitorati e usati contro di loro – forse non ora, ma ogni volta che il governo decide di perseguire un particolare tipo del linguaggio o del comportamento. Si tratta di un pericolo molto maggiore per un numero molto maggiore di bambini rispetto al pericolo rappresentato da qualsiasi contenuto specifico, perché abbraccia tutta l’attività che conducono online, toccando quasi ogni aspetto della loro vita.

Ecco un esempio per illustrare questo pericolo: supponiamo che tuo figlio giochi a molti videogiochi interattivi online. Diciamo che preferisce i giochi progettati da aziende cinesi. Forse guarda anche gli altri giocare a quei giochi e partecipa a chat e gruppi di discussione su quei giochi, a cui partecipano anche molti cittadini cinesi.

Il governo potrebbe decidere il mese prossimo, o l’anno prossimo, che chiunque sia fortemente coinvolto nella produzione di videogiochi progettati in Cina rappresenta un pericolo per la democrazia. Ciò potrebbe comportare la chiusura degli account sui social media di tuo figlio o il negargli l'accesso a strumenti finanziari, come i prestiti universitari. Potrebbe anche comportare la segnalazione di siti di lavoro o di incontri come pericolosi o indesiderabili. Potrebbe significare che gli viene negato il passaporto o che viene inserito in una lista di controllo.

La vita di tuo figlio adolescente è diventata molto più difficile. Molto più difficile che se fosse esposto a un video di reclutamento dell’Isis o a un post su TikTok che glorifica il suicidio. E questo accadrebbe su una scala molto più ampia di quella sfruttamento sessuale utilizzato dalla censura come cavallo di Troia per normalizzare l’idea della censura governativa online.

Servizi di censura monetizzabili: Uno strumento di intelligenza artificiale di proprietà del governo può teoricamente essere utilizzato da un'entità non governativa con il permesso del governo e con la benedizione delle piattaforme che vogliono “esternalizzare” la “responsabilità” della censura. Quindi, mentre il governo potrebbe utilizzare l’intelligenza artificiale per monitorare e sopprimere, diciamo ad esempio, il sentimento contro la guerra, un’azienda potrebbe usarla per monitorare e sopprimere, diciamo ad esempio, il sentimento contro il fast food. Il governo potrebbe guadagnare molti soldi vendendo i servizi degli strumenti di intelligenza artificiale a terzi. Anche le piattaforme potrebbero eventualmente chiedere un taglio. Pertanto, gli strumenti di censura dell’intelligenza artificiale possono potenzialmente avvantaggiare il governo, le piattaforme tecnologiche e le società private. Gli incentivi sono così potenti che è quasi impossibile immaginare che non verranno sfruttati.

Possiamo invertire la rotta?

Non so quante agenzie governative e quante piattaforme utilizzino strumenti di censura dell’IA. Non so quanto velocemente potranno espandersi.

Non so quali strumenti abbiamo a nostra disposizione, oltre alla sensibilizzazione e al tentativo di esercitare pressioni sui politici e avviare azioni legali per prevenire la censura governativa e regolamentare l’uso degli strumenti di intelligenza artificiale su Internet.

Se qualcuno ha altre idee, ora sarebbe il momento di metterle in pratica.

Pubblicato sotto a Licenza internazionale Creative Commons Attribution 4.0

Per le ristampe, reimpostare il collegamento canonico all'originale Istituto di arenaria Articolo e Autore.